Exploration des outils de test d’agent et considérations

Objectifs de formation

Une fois cette unité terminée, vous pourrez :

- Expliquer l’importance des tests d’agents

- Décrire les outils que vous pouvez utiliser pour tester votre agent

- Aborder les éléments à prendre en compte en ce qui concerne les tests d’agents et les moyens de les gérer

Avant de commencer

Avant de commencer ce module, nous vous invitons à consulter entièrement le contenu recommandé suivant. Les modules suivants fournissent une base sur laquelle le présent module repose.

-

Trailhead : Agentforce : planification d’agents

-

Trailhead : Concepts de base du générateur Agentforce

-

Trailhead : Couche de confiance Einstein

Introduction

L’intelligence artificielle (IA) et l’essor des agents IA redéfinissent notre façon de concevoir le développement logiciel. Dans de nombreuses entreprises, les administrateurs et développeurs Salesforce qui ont passé des années à administrer ou à personnaliser les solutions Salesforce sont désormais chargés de créer des agents Agentforce. Cela nécessite une évolution de leurs compétences, des outils qu’ils utilisent et de leur état d’esprit. Bien que les étapes familières et traditionnelles de la gestion du cycle de vie des applications (à savoir la conception, la configuration, les tests, le déploiement et l’observation) s’appliquent également au processus de cycle de vie de développement d’agents, l’intégration de l’IA générative à l’équation peut réserver quelques surprises, notamment en ce qui concerne les tests des agents.

Dans ce module, vous découvrirez les outils disponibles dans Studio Agentforce pour tester et dépanner vos agents, les éléments à prendre en compte pour vous aider dans vos tests, ainsi que les stratégies de test que vous pouvez utiliser pour rendre les réponses des agents plus précises et prévisibles.

Pourquoi effectuer des tests ?

Si vous avez obtenu le badge Agentforce : planification d’agents, vous avez suivi Nora Alami, de chez Coral Cloud Resorts, alors qu’elle planifiait un agent capable de créer et de gérer une expérience client. Vous avez appris à définir des critères tels que l’audience, la portée, les cas d’utilisation, les garde-fous et les tâches à accomplir. Ces spécifications sont les mêmes que celles que vos tests doivent valider afin de garantir que les performances de votre agent correspondent au travail pour lequel vous l’avez conçu.

Outils pour tester et dépanner votre agent

Garantir que votre agent réponde de façon précise et prévisible aux entrées utilisateur peut sembler complexe, surtout si l’on tient compte de toutes les demandes utilisateur que vos sous-agents, actions et garde-fous doivent être en mesure de gérer. Avec autant de variables en jeu, la cause d’une réponse inexacte, d’un message d’erreur ou d’une hallucination peut se trouver dans une instruction, une action, des données ou un ensemble d’autorisations. C’est pourquoi Studio Agentforce vous propose deux niveaux de test pour vous assurer que votre agent est capable de fournir des réponses fiables et prévisibles : un aperçu des tests dans le générateur Agentforce et des tests à grande échelle dans les suites de tests (bêta).

Outils de test et de dépannage du générateur Agentforce

Le générateur Agentforce propose plusieurs outils qui vous permettent de tester les conversations et d’examiner la façon dont l’agent a trouvé ses réponses, afin que vous puissiez itérer votre agent avant de le lancer auprès de vos utilisateurs. Examinons-la de plus près.

Preview (Aperçu) (1) : les choses deviennent intéressantes lorsque vous arrivez à l’étape qui vous permet de commencer à converser avec votre agent dans le panneau Preview (Aperçu) du générateur Agentforce. Le panneau Preview (Aperçu) vous permet de tester des conversations que vos utilisateurs pourraient entretenir avec votre agent afin de voir s’il réagit de la manière attendue. Vous pouvez choisir entre deux modes d’aperçu (2) :

-

Simulate (Simuler) : testez votre agent avec des données et des actions fictives.

-

Live Test (Test réel) : utilisez des données réelles pour connaître les performances de votre agent.

La sortie générée dans Preview (Aperçu) vous permet de voir si votre agent fournit des réponses utiles et pertinentes, appelle les bonnes actions, référence correctement vos processus métier et reste dans les limites des garde-fous que vous avez définis.

Interaction Summary (Résumé des interactions) (3) : passez en revue, sans entrer dans les détails, les étapes que l’agent a utilisées pour renvoyer sa réponse, y compris les sous-agents et le raisonnement qu’il a appelés.

Agentforce Session Tracing (Traçage de session Agentforce) (4) : affichez tous les détails survenus au cours d’une session d’agent afin d’enquêter sur les interactions des agents ou de les dépanner. Examinez les exécutions du moteur de raisonnement, les actions, les entrées/sorties de l’instruction générative et de la passerelle, les messages d’erreur et les réponses finales en vue de texte ou de code (5), le tout placé sous l’ID de session pour chaque session. La fonctionnalité Agentforce Session Tracing (Traçage de session Agentforce) nécessite Data 360.

Agentforce Session Tracing (Traçage de session Agentforce) s’avère également utile après le lancement de votre agent, car vous pouvez examiner les types d’échanges entre vos utilisateurs et vos agents, notamment les entrées fournies à l’agent et la manière dont il a répondu. Cela peut vous aider à localiser et à résoudre un problème, ou à ajuster votre agent afin qu’il traite des entrées que vous n’aviez pas anticipées. Grâce au suivi de session, vous pouvez savoir si vous devez définir des garde-fous supplémentaires, ou affiner vos instructions ou vos actions afin d’apporter des réponses plus ciblées.

Suites de tests Studio Agentforce

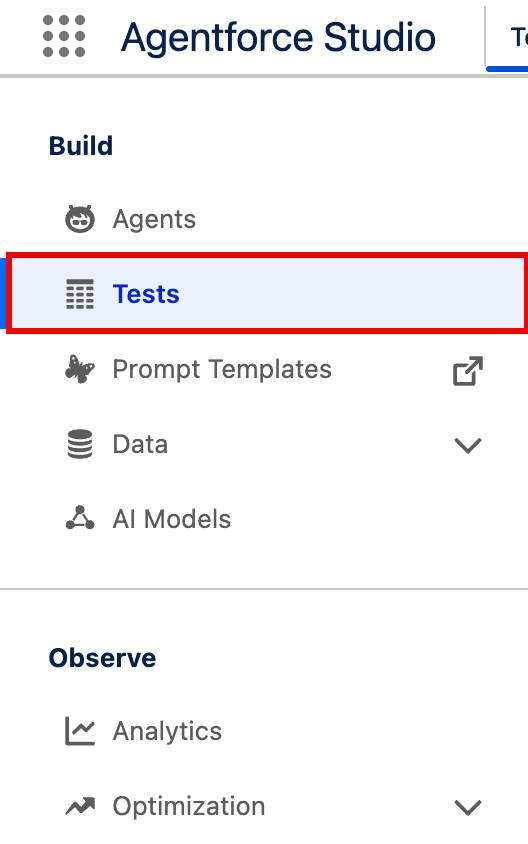

Après avoir affiné les performances de votre agent dans le générateur Agentforce, vous êtes prêt à le tester par lot dans les suites de tests (bêta) Studio Agentforce. Pour accéder aux suites de tests (bêta), ouvrez Agentforce Studio (Studio Agentforce) à partir du lanceur d’application, puis cliquez sur Tests.

Vous vous dites peut-être que vous avez déjà testé votre agent dans Preview (Aperçu) dans le générateur Agentforce et qu’il ne semble pas nécessaire de le tester par lot dans les suites de tests (bêta). Eh bien, imaginer toutes les façons dont un utilisateur pourrait poser une question ou interagir avec votre agent, puis les tester une à une dans la fenêtre Preview (Aperçu) vous prendrait beaucoup de temps. Les suites de tests (bêta) simplifient le processus en testant des dizaines, voire des centaines de scénarios à la fois. Par exemple, vous pouvez charger un fichier .csv de scénarios de test que vous avez rédigés en langage naturel, ou vous pouvez demander aux suites de tests (bêta) d’utiliser l’IA pour générer des entrées test pertinentes pour les tâches effectuées par votre agent.

Lorsqu’un test par lot est exécuté, les résultats vous indiquent l’entrée qui a été testée ainsi que les sous-agents et actions attendus et réels qu’elle a appelés, la réponse attendue, et la réussite ou l’échec de chaque entrée. Si vous avez besoin de plus d’informations sur la raison de l’échec d’une entrée test, vous pouvez copier-coller l’entrée dans le panneau Preview (Aperçu) du générateur Agentforce et examiner le cheminement suivi par l’agent pour aboutir à la réponse en échec dans la zone de dessin du plan. Cela vous permet d’affiner davantage vos instructions, ce qui améliore l’expérience utilisateur. Pour obtenir des informations détaillées sur les suites de tests (bêta), et l’écriture ou la génération de scénarios de test, reportez-vous à Agentforce : tests des agents.

Considérations relatives aux tests d’agents

Dans le cadre de tests d’applications traditionnels, vous planifiez chaque détail de votre application avant même de commencer à la concevoir. La réussite se mesure à la production de résultats prévisibles et reproductibles. Il s’agit d’une approche déterministe. Votre solution fonctionne comme prévu, ou elle ne fonctionne pas. En revanche, bien que le développement d’un agent nécessite également une planification en amont, vous affinez, testez et révisez votre agent à mesure que vous le concevez. Les tests d’agents sont probabilistes, ce qui signifie que leurs résultats peuvent être moins prévisibles, uniques et, parfois, surprenants en raison de l’absence de logique basée sur des règles dans l’IA générative. Une même entrée peut générer de nombreuses réponses différentes, mais correctes, certaines réponses incorrectes, voire, parfois, des hallucinations. Il est également difficile d’anticiper toutes les façons dont un utilisateur peut interagir avec votre agent. Vous devez donc prendre en compte et tester une variété de scénarios lors de sa conception. De cette façon, vous minimisez les réponses qui ne correspondent pas à l’entrée de l’utilisateur ou qui sont inexactes.

Comment déterminer quand votre agent est prêt pour la production

En raison de la nature probabiliste du comportement de l’agent, il n’est pas évident de déterminer quand il est prêt pour la production. Chaque entreprise doit déterminer sa propre référence pour les taux de réussite/d’échec dans divers scénarios. Il n’existe pas de bonne réponse et le niveau de précision souhaité peut varier d’un secteur d’activité à l’autre. Pour commencer, il est utile d’évaluer avec quelle précision un être humain effectuerait la même tâche, par exemple traiter des questions relatives aux réservations, et d’utiliser cette analyse comme référence. Vous pouvez ensuite vous efforcer de faire en sorte que votre agent atteigne ou dépasse ce niveau de précision.

Test systématique dans une organisation sandbox

Les tests effectués sur vos agents pouvant modifier vos données de CRM, vous devez toujours utiliser les suites de tests (bêta) dans un environnement sandbox, jamais dans votre environnement de production.

Utilisation de plusieurs critères pour évaluer votre réponse

Pour obtenir les réponses que vous souhaitez à partir de vos entrées dans le panneau Preview (Aperçu), il vous faudra probablement faire plusieurs essais et commettre quelques erreurs. La conception d’un agent est un processus itératif. De plus, pour tenir compte des différents types d’entrées, vous devrez procéder à quelques révisions, notamment en peaufinant la formulation, en vérifiant les autorisations, en validant les données ou en ajoutant des détails ou des garde-fous supplémentaires à vos instructions. Les commentaires que vous recevrez dans la zone de dessin du plan, les journaux d’événements ou les suites de tests (bêta) vous aideront à identifier les points sur lesquels vous devez améliorer les sous-agents, les actions ou les instructions de votre agent afin d’obtenir des réponses qui se rapprochent du niveau de précision souhaité.

Voici quelques éléments clés à prendre en compte lorsque vous testez votre agent et les solutions associées.

Considération relative aux tests |

Manières d’affiner votre agent |

|---|---|

L’agent a-t-il suivi mes instructions ? |

|

La réponse est-elle précise, complète et facile à lire ? |

|

La réponse est-elle ancrée dans mes données ? |

|

La réponse correspond-elle à l’identité de ma marque ? |

|

Combien de temps a pris la réponse ? |

|

La réponse est-elle biaisée ou toxique ? |

|

La réponse est-elle toujours fiable ? |

|

Coûts associés aux tests

Une dernière considération relative aux tests concerne leurs coûts d’exécution. Tester votre agent dans les suites de tests (bêta) peut consommer des demandes ou des crédits. Ces requêtes et crédits sont des métriques d’utilisation facturable pour l’IA générative qui entraînent des coûts pour votre organisation. Pour en savoir plus, consultez la documentation d’aide Types d’utilisation facturable de l’IA générative ou parlez-en à votre chargé de compte.

Conclusion

Les tests d’agents nécessitent une approche et une méthode de travail différentes de celles utilisées pour les tests d’applications traditionnels. Si l’on tient compte de toutes les variables susceptibles d’influencer les réponses de votre agent, il n’est pas étonnant que les tests d’agents soient plus subjectifs que les tests de logiciels traditionnels. Maîtriser les outils de test Agentforce et comprendre comment atténuer les facteurs qui ont une incidence sur les performances des agents peut vous aider à atteindre rapidement le niveau de précision souhaité. Dans l’unité suivante, vous découvrirez l’importance de créer une stratégie de test d’agent pour guider vos tests.