応答ジャーニーをたどる

学習の目的

この単元を完了すると、次のことができるようになります。

- 応答ジャーニーについて説明する。

- データ保持ゼロについて説明する。

- 有害言語検出が重要な理由を話し合う。

Trailcast

このモジュールの音声録音をお聞きになりたい場合は、下記のプレーヤーを使用してください。この録音を聞き終わったら、必ず各単元に戻り、リソースを確認して関連付けられている評価を完了してください。

プロンプトジャーニーの復習

Jessica の顧客データとその会社データを保護するために、Salesforce が Einstein Trust Layer を使用して慎重な措置を講じていることはおわかりいただけたかと思います。先に進む前に、プロンプトジャーニーを簡単に復習しておきましょう。

- Jessica のカスタマーサービスケースを補佐するために、サービス返信から自動的にプロンプトテンプレートが取り込まれました。

- プロンプトテンプレートの差し込み項目に、Jessica の組織から信頼できる安全なデータが入力されました。

- プロンプトのコンテキストを明確にするために、関連するナレッジ記事やほかのオブジェクトの詳細が取得され追加されました。

- 個人識別情報 (PII) がマスクされました。

- 保護を強化する目的で、プロンプトにセキュリティガードレールが適用されました。

- これで、プロンプトがセキュアゲートウェイを通過して外部 LLM に達することができます。

セキュア LLM ゲートウェイ

関連データが入力され、保護対策が講じられたプロンプトは、セキュア LLM ゲートウェイを通過して Salesforce 信頼境界内から離れ、接続されている LLM に達することができます。このケースで、Jessica の組織が接続している LLM は OpenAI です。OpenAI はこのプロンプトを使用して、Jessica が顧客との会話に使用できる高質で関連性の高い応答を生成します。

データ保持ゼロ

Jessica が堅牢な信頼レイヤーを介さずに、生成 AI チャットボットなどの消費者向け LLM ツールを使用すれば、あらゆる顧客データをはじめ、プロンプトや LLM の応答も、モデルのトレーニングの目的で LLM に保存される可能性があります。そこで、Salesforce は外部の API ベースの LLM と提携する際に、対話全体の安全性を確保する協定への合意を求めています。この協定をデータ保持ゼロといいます。Salesforce のデータ保持ゼロポリシーは、プロンプトテキストや生成された応答を含む顧客データが Salesforce の外部に一切保存されないことを定めています。

その場合は、 Jessica のプロンプトが LLM に送信されます。前述のとおり、このプロンプトは指示です。LLM はこのプロンプトを受け取り、ガードレールを踏まえてその指示に従い、1 つ以上の応答を生成します。

OpenAI は通常、悪用を監視する目的で、プロンプトとプロンプトの応答を一定期間保持したいと考えています。OpenAI の極めて強力な LLM は、モデルに何か異常なことが起こっていないかチェックします。たとえば、前の単元で説明したプロンプトインジェクション攻撃などです。けれども、Salesforce のデータ保持ゼロポリシーにより、LLM のパートナーは対話のデータを一切保持できません。そこで、Salesforce がそのモデレーションを処理することで合意に達しました。

Salesforce は OpenAI が何かを保存することを認めていません。ですから、プロンプトが OpenAI に送信された場合、応答が Salesforce に送信されたらすぐ、モデルはプロンプトと応答を忘れ去ります。こうした合意によって Salesforce が自らのコンテンツと不正使用のモデレーションを処理できるようになるため重要です。さらに、Jessica のようなユーザーが、LLM プロバイダーが顧客のデータを保持して使用するのではないかと心配する必要がありません。

応答ジャーニー

初めて Jessica が登場したとき、AI が生成した返信が本人の誠実な対応にそぐわないのではないかとやや不安になっていると述べました。どのように処理されるのか Jessica にはよくわかりませんでしたが、Einstein Trust Layer が対処してくれるため、心配する必要はありません。Einstein Trust Layer には、会話をパーソナライズしてプロフェッショナルな体裁にする数種の機能が搭載されています。

これまでに、Jessica と顧客の会話に基づくプロンプトテンプレートに、関連する顧客情報と、ケースに関する有益なコンテキストが入力されるところを見てきました。ここで、LLM がこうした詳細を処理して、Salesforce 信頼境界に応答を返します。ただし、まだ Jessica が確認することはできません。フレンドリーな口調で、内容は正確ですが、想定外の出力がないか Trust Layer がチェックする必要があります。応答にマスクされたデータのブロックが残っているため、まったくパーソナライズされておらず、Jessica はとても顧客に見せられないでしょう。応答を共有する前に Trust Layer が実行すべき重要なアクションがまだ残っています。

<NAME_1> 様 ご連絡いただきありがとうございます。クレジットカードのアップグレードで問題が生じ、申し訳ございません。<COMPANY_1> を 5 年以上にわたってご愛顧いただいていることに感謝し、この問題の速やかな解決に努めます。

おっしゃるとおり、弊社のクレジットカードの中には、信用スコアの最低値が定められているものがあります。* 申し込みの手続きでどのような問題が生じたのか詳しく説明していただけますか?

ソース: Cumulus カードのアップグレードの最低要件

有害用語検出とデータマスキングの解除

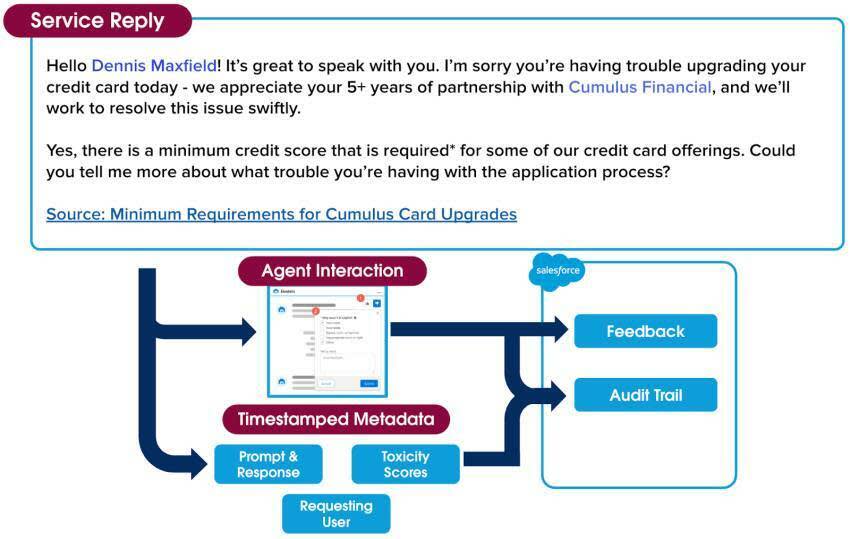

Jessica の会話に対する応答が LLM から Salesforce 信頼境界に戻されるときに、2 つの重要なアクションが実行されます。まず、有害用語検出は Jessica とその顧客に有害な応答が届かないようにします。どういうことなのでしょうか? Trust Layer は機械学習モデルを使用して、プロンプトや応答の有害なコンテンツを、暴力的、性的、冒涜的、憎悪的、身体的という 5 つのカテゴリで識別してフラグを立てます。有害性の全体スコアは、検出された全カテゴリのスコアの合計で、1 を最も有害とする 0 ~ 1 の範囲で算出されます。最初の応答のスコアは、その応答と共にコール元のアプリケーション (この場合はサービス返信) に返されます。

次に、プロンプトが Jessica と共有される前に、Trust Layer が前述のデータのマスキングを解除して、応答が Jessica の顧客に合わせてパーソナライズされ、関連したものにする必要があります。Trust Layer は、以前にデータをマスクしたときに保存したものと同じトークン化されたデータを使用して、マスクを解除します。データのマスクが解除されると、応答が Jessica と共有されます。

また、応答の下部にソースリンクがあります。ナレッジ記事の作成により、役立つソース記事へのリンクが追加され、応答の信頼性が高まります。

Dennis Maxfield 様 ご連絡いただきありがとうございます。クレジットカードのアップグレードで問題が生じ、申し訳ございません。Cumulus Financial を 5 年以上にわたってご愛顧いただいていることに感謝し、この問題の速やかな解決に努めます。

おっしゃるとおり、弊社のクレジットカードの中には、信用スコアの最低値が定められているものがあります。* 申し込みの手続きでどのような問題が生じたのか詳しく説明していただけますか?

ソース: Cumulus カードのアップグレードの最低要件

フィードバックフレームワーク

応答を初めて目にした Jessica の顔がほころびます。LLM から受け取った応答の質と情報の細かさに感心します。また、自らの心のこもった対応にこの応答がうまく溶け込むことにも満足します。顧客に送信する前に応答を確認していた Jessica は、応答をそのまま受け入れるか、送信前に編集するか、無視するかを選択できることを知ります。

さらに、(1) 高評価と低評価を使用して定性的なフィードバックを送信し、(2) 応答が役に立たなかった場合にはその理由を明記することもできます。こうしたフィードバックは収集され、将来的にプロンプトの質を高める目的で安全に使用されます。

監査履歴

Trust Layer の最後の機能を紹介します。この単元の冒頭で言及したデータ保持ゼロポリシーを覚えていますか? Trust Layer で有害用語のスコアリングやモデレーションが内部処理されるため、Salesforce はプロンプトから応答までのジャーニーを通して実施されるすべてのステップを追跡します。

Jessica と顧客間のこのやり取りで起こったことがすべてタイムスタンプの付いたメタデータとなり、監査履歴に収集されます。たとえば、プロンプト、点検前の元の応答、有害言語スコア、途中で収集されたフィードバックなどがこれに該当します。Einstein Trust Layer の監査履歴によってさらなる説明責任が果たされるため、顧客データが保護されていることを Jessica は確信できます。

Jessica が顧客に対応し始めてから多くのことが行われましたが、実際にはこのすべてが一瞬で処理されます。Jessica の会話が数秒のうちに、チャットからコールされたプロンプトになり、Trust Layer プロセス全体のセキュリティを経て、関連性の高いプロフェッショナルな体裁の応答になり、顧客と共有できるようになりました。

顧客が受け取った応答とカスタマーサービスエクスペリエンスに満足していることを確認した Jessica は、ケースをクローズします。そして何よりも、サービス返信の生成 AI によってケースを迅速にクローズし、顧客を喜ばせることができると実感した Jessica は、この機能に大きな期待を寄せています。

Salesforce 生成 AI のどのソリューションも、同じ Trust Layer ジャーニーを進行します。Salesforce のソリューションはすべて安全であるため、各自のデータも顧客のデータも安全であることを確信できます。

お疲れさまでした。Einstein Trust Layer のしくみについて学習しました。信頼と生成 AI にまつわる Salesforce の取り組みについての詳細は、「人工知能の責任ある作成」Trailhead バッジを参照してください。

リソース