Aprender la manera en la que Salesforce utiliza los modelos de lenguaje grandes

Objetivos de aprendizaje

Después de completar esta unidad, podrá:

- Describir cómo incorpora Salesforce la confianza en los LLM.

- Elegir la opción de LLM correcta para su empresa.

- Describir las limitaciones de las opciones de LLM disponibles.

Liderazgo con confianza

La confianza es el valor principal de Salesforce. Por este motivo, tiene sentido que Salesforce exija que se utilicen los modelos de lenguaje grandes (LLM) de una forma segura y confiable. Y la clave para mantener esta confianza es a través de la Capa de confianza de Einstein. La Capa de confianza de Einstein garantiza que la IA generativa sea segura mediante controles de datos y de privacidad que están integrados en la experiencia del usuario final de Salesforce. Estos controles permiten que Einstein proporcione IA que utilice de forma segura la generación aumentada de recuperación (RAG) para anclar bien los datos del cliente y de la empresa, sin presentar posibles riesgos de seguridad. En su forma más sencilla, la Capa de confianza de Einstein es una secuencia de pasarelas y mecanismos de recuperación que, juntos, proporcionan una IA generativa de confianza y abierta.

Agentes de confianza de Salesforce

Los agentes de Agentforce utilizan LLM líderes del sector a través de la Capa de confianza de Einstein usando la generación aumentada de recuperación para crear solicitudes seguras con datos de Salesforce y Data Cloud. De esta forma, se genera un entorno enriquecido y seguro en el que usar agentes de IA capaces de ayudar a los empleados y los clientes. Estos agentes no solo ofrecen sugerencias, sino que pueden completar tareas de forma independiente. Por ejemplo, permiten gestionar consultas de clientes, resolver problemas e incluso hacer recomendaciones de ventas sin intervención de personas. Todo esto mientras se usa la Capa de confianza para proteger los datos y ofrecer buenas respuestas.

Elegir el mejor gran modelo de lenguaje.

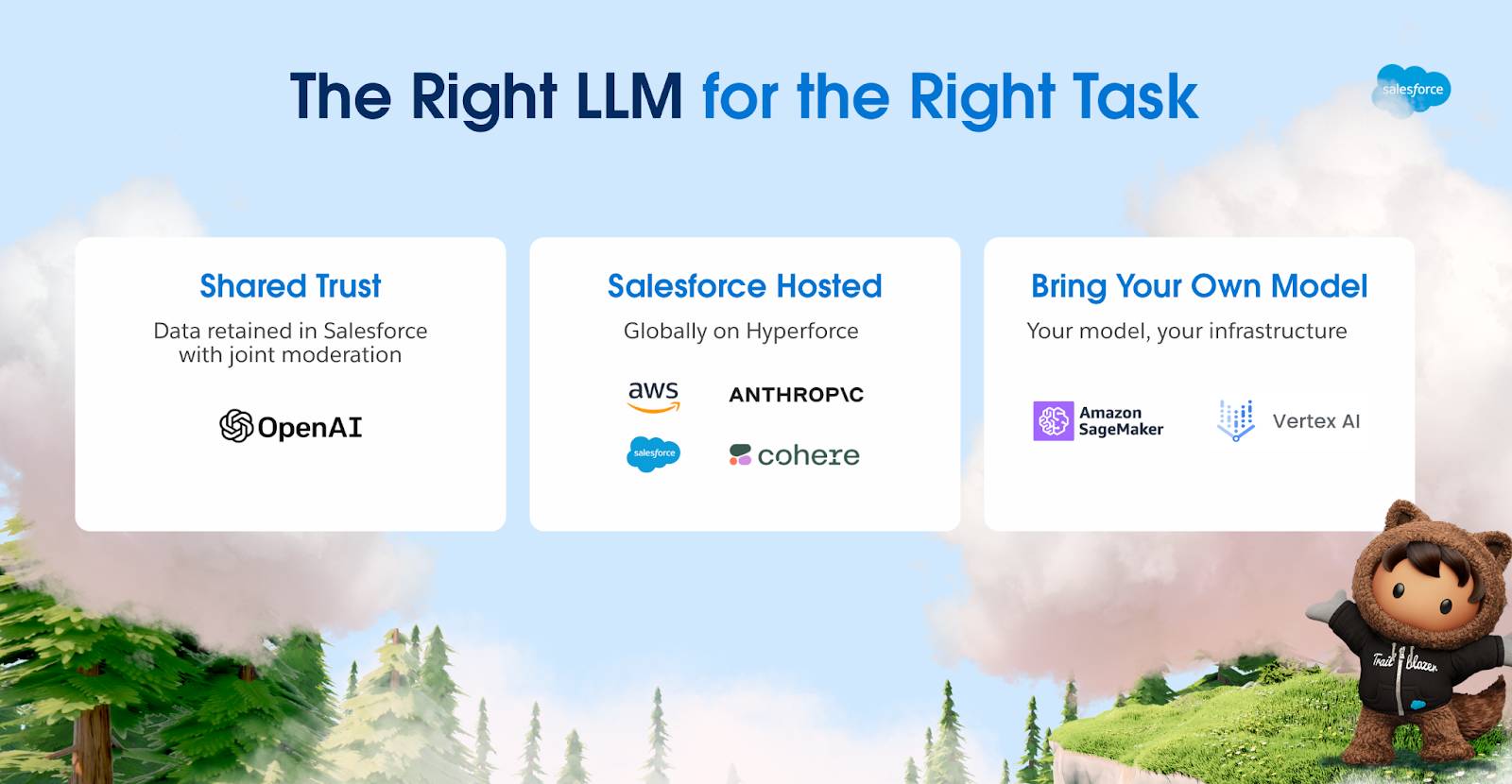

La elección del modelo adecuado para la tarea correcta le ayudará a introducirse en la IA generativa más rápido. Salesforce proporciona capacidades de implementación para cualquier LLM relevante mientras ayuda a las empresas a mantener la privacidad, la seguridad y la residencia de datos, y los objetivos de cumplimiento.

Es posible que muchos LLM se utilicen dependiendo de los diferentes casos de uso. Los clientes querrán implementar los LLM de diferentes maneras puesto que es posible que les preocupe la residencia de datos.

Utilizar LLM compartidos de Salesforce

Los LLM compartidos de Salesforce son una forma de acceder a LLM en Internet. Fuimos los primeros en implantar esta técnica con nuestro socio OpenAI. Salesforce utiliza una puerta de enlace segura para navegar por Internet y pedir a sus increíbles LLM una respuesta.

Einstein permite que los clientes utilicen los LLM de Salesforce desarrollados por Salesforce AI Research para desarrollar capacidades avanzadas, como la generación de código y la asistencia para la automatización de procesos empresariales, lo que transforma radicalmente la forma en que las empresas interactúan con su software de CRM. Los LLM de Salesforce, como CodeGen, CodeT5+ y CodeTF, ayudan a las empresas a mejorar la productividad, suplir las necesidades de talento, reducir el coste de las implementaciones y mejorar la detección de incidentes.

Usar LLM de terceros alojados en Salesforce

También puede alojar modelos dentro de Salesforce.

Como parte del compromiso de Salesforce con un ecosistema abierto, Einstein se ha diseñado para alojar LLM de Amazon, Anthropic, Cohere y otros terceros, todo ello dentro de la infraestructura de Salesforce. Con Einstein, se pueden mantener las solicitudes y respuestas en la infraestructura de Salesforce. Además, Salesforce y OpenAI han establecido una colaboración de confianza con el fin de ofrecer contenido mediante la Capa de confianza de Einstein.

Bring Your Own Model

Si ya ha realizado una inversión en su propio modelo, puede resultarle útil la opción Bring Your Own Model (BYOM, por sus siglas en inglés).

Podrá beneficiarse de Einstein aunque haya entrenado sus modelos específicos para dominios fuera de Salesforce al mismo tiempo que almacena los datos en una infraestructura propia. Estos modelos, ya se ejecuten a través de Amazon SageMaker o Google Vertex AI, se conectarán directamente con Einstein gracias a la Capa de confianza de Einstein. En este caso, los datos se pueden conservar dentro de los límites de confianza de los clientes.

Las opciones de tipo BYOM cambian a gran velocidad. Consulte con frecuencia los recursos disponibles para enterarse de las novedades.

Recursos

- Trailhead: Capa de confianza de Einstein

- Trailhead: Enmascaramiento de datos de modelos de lenguaje grandes en la Capa de confianza de Einstein

- Trailhead: Generación aumentada de recuperación: un vistazo rápido

- Ayuda de Salesforce: Capa de confianza de Einstein: diseñada para la confianza

- Ayuda de Salesforce: Bring Your Own Model

- Trailhead: Preparar sus datos para la IA

- Novedades e información sobre Salesforce: Salesforce anuncia la incorporación de IA generativa de confianza en las empresas gracias a la nube de IA

- Trailhead: Introducción a la inteligencia artificial

- El blog 360 de Salesforce: 4 Ways Large Language Models Help You Do More With Customer Data (Cuatro formas en que los modelos de lenguaje grandes le permiten hacer más con los datos de clientes)

- Ayuda sobre Salesforce Data Cloud: Bring Your Own Model

- Novedades e información: Salesforce lanza una opción BYOM para facilitar a las empresas el uso de datos propios para desarrollar e implementar modelos de IA

- Blog de desarrolladores: Bring Your Own AI Models to Data Cloud (Incorpore sus propios modelos de IA en Data Cloud)