Erweitern von Agenten und Prompts mit relevantem Geschäftswissen

Lernziele

Nachdem Sie diese Lektion abgeschlossen haben, sind Sie in der Lage, die folgenden Aufgaben auszuführen:

- Erläutern, warum erweiterte Abrufgenerierung (Retrieval Augmented Generation, RAG) die Genauigkeit und Relevanz von LLM-Antworten in Agenten und Prompt-Vorlagen verbessert.

- Beschreiben, wie Sie RAG in Ihrer Salesforce-Organisation einrichten und verwenden.

Was ist abruferweiterte Generierung (Retrieval Augmented Generation)?

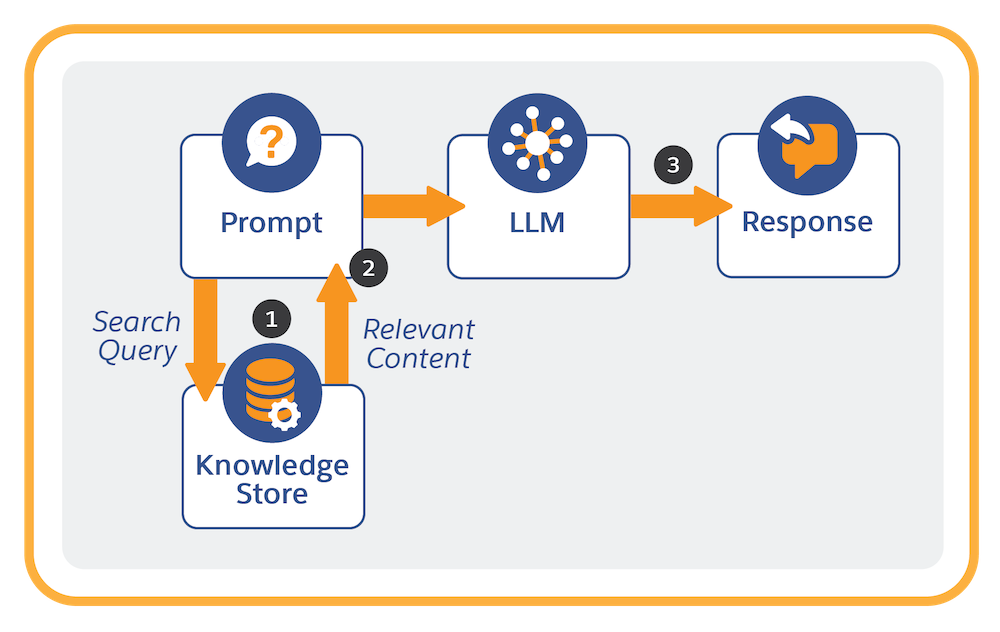

Abruferweiterte Generierung (RAG) ist eine beliebte Methode, Prompt-Anforderungen an LLMs (Large Language Models) mit Kontext zu versehen. Bei der Kontextbildung werden einem Prompt domänenspezifisches Wissen oder Kundeninformationen hinzugefügt, um dem LLM den Kontext zu geben, den es benötigt, um präziser auf eine Frage oder Aufgabe zu antworten.

Aufgeschlüsselt leistet RAG dies:

-

Abrufen relevanter Informationen aus einem Wissensspeicher, der strukturierte und unstrukturierte Inhalte enthält.

-

Erweitern des Prompts durch Kombination dieser Informationen mit dem Originalprompt.

- Mit dem erweiterten Prompt generiert das LLM eine Antwort.

Viele LLMs werden im Allgemeinen im Internet anhand statischer und öffentlich zugänglicher Inhalte trainiert. RAG fügt domänenspezifische Informationen hinzu, damit LLMs besser auf Ihre Prompts antworten können. Mit RAG können Sie wertvolle Informationen aus allen Arten von Inhalten extrahieren, darunter Serviceantworten, Kundenvorgänge, Wissensartikel, Gesprächsprotokolle, Antworten auf Ausschreibungen (RFP), E-Mails, Besprechungsnotizen, häufig gestellte Fragen (FAQs) und vieles mehr.

Schneller Einstieg in Agentforce-Lösungen mit dem Agentforce-Generator und der Agentforce-Datenbibliothek

Mit dem Agentforce-Generator können Sie mit nur wenigen Klicks nahtlos Wissensartikel auswählen oder Dateien hochladen, die von Agenten abgerufen werden können. Zu diesem Zweck können Sie eine Agentforce-Datenbibliothek erstellen oder auswählen, eine Bibliothek aus Inhalten, die der Agent zur Beantwortung von Fragen verwendet. Wählen Sie die Quelle aus, aus der die Datenbibliothek relevante Informationen bezieht: Salesforce-Wissensdatenbank, von Ihnen hochgeladene Dateien (Text, HTML und PDFs) oder eine Websuche. Zur Laufzeit nutzt Ihr Agent diese Informationen, um LLM-Prompts mit Kontext anzureichern und bessere, genauere und relevantere LLM-Antworten zu generieren.

Wenn Sie eine Datenbibliothek hinzufügen, erstellen Sie automatisch alle Elemente, die für eine funktionierende, RAG-gestützte Lösung erforderlich sind. Wenn Sie möchten, können Sie diese Elemente anschließend anpassen, um die RAG-Lösungen für Ihre Anwendungsfälle zu optimieren. Dazu kommen wir später.

Abrufen von relevantem Geschäftswissen in Agenten

Agenten rufen relevantes Wissen aus einer Datenbibliothek mithilfe der Standardaktion Answer Questions with Knowledge (Fragen mit Knowledge beantworten) ab. Diese Aktion ruft dynamisch die Informationen aus dem Wissensbestand oder den Dateiinhalten ab, die Sie beim Erstellen oder Auswählen einer Bibliothek angegeben haben.

Dies geschieht bei jeder Ausführung der Aktion 'Answer Questions with Knowledge' (Fragen mit Knowledge beantworten):

- Die Aktion führt die zugeordnete Prompt-Vorlage aus. Der Abrufer wird mit einer dynamischen Abfrage aufgerufen.

- Die Abfrage durchsucht die Datenbibliothek.

- Die Abfrage ruft die relevanten Inhalte ab.

- Der Originalprompt wird mit Informationen aufgefüllt, die aus Datenbibliothek abgerufen wurden, und wird dann an das LLM übermittelt.

- Die vom LLM generierte Antwort wird an den Agenten weitergeleitet.

Abrufen von relevantem Geschäftswissen in Prompts

Zur Laufzeit rufen Prompt-Vorlagen relevante Informationen aus Ihrer Datenbibliothek ab, um LLM-Prompts mit Kontext zu versehen und so genauere LLM-Antworten zu ermöglichen. Wenn Sie eine benutzerdefinierte Prompt-Vorlage verwenden, binden Sie im Prompt-Generator einfach einen Einstein Search-Abrufer ein, den Sie beim Einfügen einer Ressource auswählen. Sie können außerdem einen benutzerdefinierten Abrufer verwenden, der die Sucheinstellungen für jeden bestehenden Prompt optimiert.

Dies geschieht bei jeder Ausführung einer Prompt-Vorlage mit einem Abrufer:

- Der Abrufer wird mit einer dynamischen Abfrage aufgerufen, die von der Prompt-Vorlage eingeleitet wird.

- Die Abfrage wird vektorisiert (in numerische Darstellungen konvertiert). Durch die Vektorisierung kann die Suche semantische Übereinstimmungen im Suchindex finden (der bereits vektorisiert ist).

- Die Abfrage ruft die relevanten Inhalte aus den indizierten Daten im Suchindex ab.

- Der ursprüngliche Prompt wird mit den Informationen aufgefüllt, die aus dem Suchindex abgerufen wurden.

- Der Prompt wird an das LLM übermittelt, das die Promptantwort generiert und zurückgibt.

Erweiterte Anpassung in Data 360

Wenn Sie eine Datenbibliothek hinzufügen, entweder in Agentforce Builder oder über Setup, erstellt Salesforce automatisch eine RAG-gestützte Lösung unter Verwendung der Standardeinstellungen für alle Komponenten: Vektordatenspeicher, Suchindex, Abrufer, Prompt-Vorlage und Standardaktion. Sie können diese Komponenten einzeln einrichten und anpassen.

Die Datenvorbereitung in Data 360 umfasst diese Aufgaben.

- Verbinden (erfassen) Ihrer unstrukturierten Daten

- Erstellen einer Suchindexkonfiguration zur Segmentierung und Vektorisierung der Inhalte. Data 360 verwendet einen Suchindex, um strukturierte und unstrukturierte Inhalte in einer für die Suche optimierten Weise zu verwalten. Es gibt zwei Suchoptionen: Vektorsuche und Hybridsuche. In der Hybridsuche sind Vektorsuche und Stichwortsuche kombiniert.

- Bei der Segmentierung wird der Text in kleinere Einheiten aufgeteilt, die sich an Passagen des Originalinhalts orientieren, etwa an Sätzen oder Absätzen.

- Bei der Vektorisierung werden Segmente in numerische Darstellungen des Texts konvertiert, die semantische Ähnlichkeiten erfassen.

- Bei der Segmentierung wird der Text in kleinere Einheiten aufgeteilt, die sich an Passagen des Originalinhalts orientieren, etwa an Sätzen oder Absätzen.

- Speichern und Verwalten des Suchindex.

Erstellen Sie nach der Erstellung eines Suchindizes einen Abrufer in AI Models (KI-Modelle, zuvor Einstein Studio), um relevante Informationen aus diesem Suchindex für einen bestimmten Anwendungsfall abzurufen. Ein Abrufer ist eine Ressource, die Sie in eine Prompt-Vorlage einbetten, um nach relevanten Informationen aus dem Wissensspeicher zu suchen und diese zurückzugeben. Zum Unterstützen einer Vielzahl von Anwendungsfällen können Sie verschiedene Abrufer erstellen, die den Schwerpunkt auf gerade die relevante Teilmenge an Informationen legen, die dem Prompt hinzugefügt werden sollen.

RAG in der Praxis

Dieses Video zeigt, wie einfach es ist, eine Prompt-Vorlage mithilfe von RAG zu erweitern.

Fazit

Agentforce Data Library und RAG in Data 360 sind mit der generativen Einstein KI-Plattform integriert. Integrieren Sie die RAG-Funktionalität nativ in sofort einsatzbereite Anwendungen wie den Agentforce-Generator und den Prompt-Generator. Mit RAG können Sie Ihre Agentforce-Lösungen auf sichere Weise in proprietären Daten aus einem harmonisierten Datenmodell verankern und sie so verbessern.

Ressourcen

- Salesforce-Hilfe: Verwenden unstrukturierter Daten in Data 360

- Salesforce-Hilfe: Chunk-Daten

- Salesforce-Hilfe: Vektorsuche

- Salesforce-Hilfe: Hybridsuche

- Salesforce-Hilfe: Beispiel: Agenten-RAG mit Advanced Data Cloud-Setup

- Trailhead: Agentforce-Datenbibliothek – Grundlagen

- Trailhead: Verwenden unstrukturierter Daten in Data 360

- Trailhead: Suchindextypen in Data 360: Schnelleinstieg

- Trailhead: Hybridsuche für RAG: Schnelleinstieg

- Salesforce-Blog: RAG – Die derzeit heißesten 3 Buchstaben in der generativen KI (englischsprachig)

- Salesforce-Blog: Agentforce und RAG: Bewährte Vorgehensweisen für bessere Agenten (englischsprachig)